🤖 AI 为什么会 “一本正经地胡说八道”?先看几个扎心案例

你有没有遇到过这种情况?问 AI 某个历史事件的细节,它能给你编出一套时间线严丝合缝的 “伪历史”;让它写一份专业报告,里面夹杂着看似权威却完全错误的数据。更气人的是,这些错误往往包装得特别好,用词严谨、逻辑通顺,不仔细核对根本发现不了。

前阵子有个做学术研究的朋友就栽了跟头。他让 AI 整理某领域近五年的核心文献,结果 AI 凭空捏造了三篇 “高被引论文”,作者、期刊、发表时间一应俱全。等他顺着线索去找原文,才发现根本不存在。最后因为引用了假文献,差点影响了整个项目的进度。

还有更离谱的。有人用 AI 生成法律意见,结果里面的法条编号张冠李戴,甚至把已经废止的条款当成现行规定来解读。要是真有人照着执行,后果不堪设想。这些案例背后,其实藏着 AI 生成内容时的底层逻辑问题,不是简单的 “bug” 能解释的。

🧠 核心原因:AI 本质是 “预测机器”,而非 “知识专家”

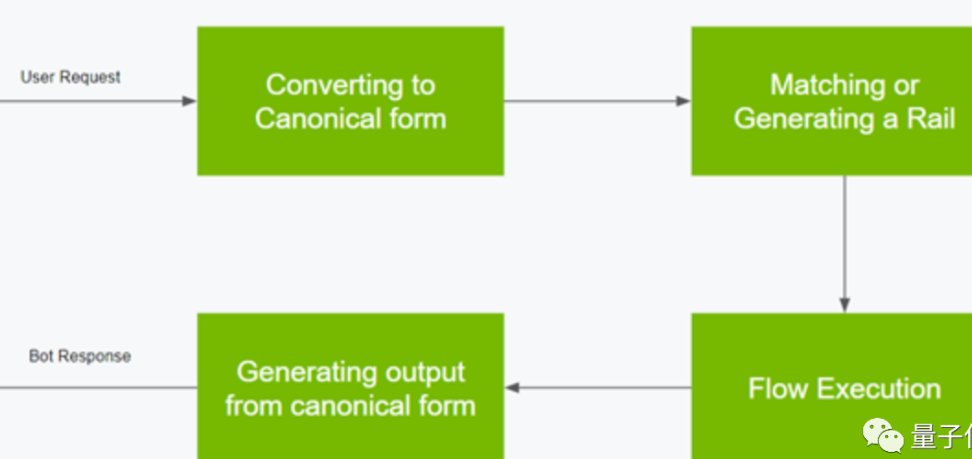

很多人对 AI 有个根本性误解:觉得它像人脑一样 “理解” 信息。其实完全不是。现在主流的生成式 AI,不管是 GPT 系列还是 Claude,本质上都是基于概率的预测模型。它的工作原理,是根据前面出现的文字,计算下一个词最可能是什么。

举个简单例子。当你输入 “天空是”,AI 会在训练过的海量文本里统计 “天空是” 后面接什么词最多 —— 可能是 “蓝色的”“广阔的”“灰蒙蒙的”。它会选概率最高的组合,让句子看起来通顺。但这个过程里,它不会 “思考” 天空为什么是蓝色,更不会去验证这个说法对不对。

这就导致一个问题:为了让输出内容流畅连贯,AI 会优先保证句子的 “概率合理性”,而不是 “事实准确性”。特别是遇到它不熟悉的领域,或者信息链断裂的时候,它会 “硬编” 一个看起来合理的答案,而不是说 “我不知道”。这就是为什么 AI 经常在专业问题上 “一本正经地撒谎”—— 它只是在完成 “续写句子” 的任务,根本没有 “对错” 的概念。

还有个容易被忽略的点:AI 的训练数据截止到某个时间点。比如 ChatGPT 的训练数据只到 2023 年 10 月,你问它 2024 年的事件,它要么拒绝回答,要么就只能基于旧数据 “推测”,这种推测十有八九会出错。这不是它故意骗你,是它真的 “不知道” 最新情况。

📊 训练数据里的 “隐形陷阱”:错误是怎么被 “教” 给 AI 的

AI 的所有表现,都能在训练数据里找到源头。你可能会想,现在的 AI 训练数据都是互联网级别的,怎么还会有这么多错误?问题就出在 “互联网级别的数据” 本身。

互联网上的信息,大概只有 30% 是经过严格验证的。剩下的 70% 里,有主观臆断、有过时信息、有营销软文,甚至有故意传播的谣言。AI 在训练时,会把这些内容一视同仁地 “吸收” 进去,不会分辨哪些是真的,哪些是假的。

更麻烦的是 “数据偏见”。比如某类信息在训练数据里出现的频率特别高,AI 就会默认它是 “正确答案”。之前有测试显示,当问到 “哪些国家的人数学最好” 时,部分 AI 会倾向于给出训练数据里提到最多的几个国家,哪怕这个结论没有任何科学依据。这不是 AI 有偏见,是它被数据 “带偏” 了。

还有数据 “污染” 的问题。现在很多 AI 生成的内容又被爬回去当成训练数据,形成了 “自循环”。就像传话游戏,原始信息经过几轮 AI 加工,错误会被不断放大。你现在用 AI 生成的内容,可能已经掺杂了好几层 AI 自己编的东西,准确性可想而知。

🏗️ 模型架构的 “设计缺陷”:为什么越复杂的问题越容易出错

现在的大语言模型,基本都用 Transformer 架构。这个架构的优势是能处理长文本,但也有个天生的 “短板”——上下文窗口有限。比如 GPT-3.5 的上下文窗口是 4096 个 token,大概能装下 3000 字的内容。

这意味着什么?当你问一个需要结合大量背景信息的复杂问题时,AI 只能 “记住” 窗口内的内容,前面的信息可能会被 “遗忘”。比如你让它写一篇分析报告,先给了 10 条前提条件,写着写着,它可能就把第 3 条或第 7 条给漏掉了,结论自然会跑偏。

模型的 “参数规模” 也会影响准确性。参数少的模型,处理信息的能力弱,容易在细节上出错;但参数多的模型,虽然能处理更复杂的任务,却可能因为 “想太多” 而过度解读,反而生成错误关联。比如你问 “某公司的营收情况”,它可能会把同行业其他公司的数据 “嫁接” 过来,因为这些数据在训练时经常一起出现。

还有一个技术细节:“温度参数” 的设置。温度越高,AI 生成内容的随机性越强,虽然可能更有创造力,但错误率也会飙升;温度太低,内容又会显得僵硬重复。大多数时候,AI 的默认温度设置是偏向 “流畅性” 的,这就为错误埋下了伏笔。

📝 写好 Prompt 的黄金法则:从 “提问者” 变成 “引导者”

知道了 AI 为什么会胡说八道,就能有针对性地优化 prompt。核心思路是:不要让 AI “自由发挥”,要给它明确的 “框架” 和 “约束”。

首先,限定 AI 的 “身份” 和 “知识范围”。比如你问法律问题,不要直接说 “帮我分析这个案例”,可以说 “假设你是一名有 10 年经验的民法律师,只根据 2023 年修订的《民法典》回答,不清楚的地方直接说不知道”。给 AI 一个具体的 “角色”,它会更倾向于调用相关领域的训练数据,减少跨领域错误。

其次,把复杂问题拆成 “步骤化指令”。AI 处理线性任务的能力远强于处理复杂任务。比如你让它写一篇市场分析,不要说 “写一篇关于某产品的市场分析”,可以拆成:“1. 先列出该产品的 3 个核心竞品;2. 分别对比它们的价格、功能、用户评价;3. 总结该产品的竞争优势,只基于公开数据,不做主观推测”。步骤越清晰,AI 越不容易跑偏。

最后,强制要求 AI “验证信息来源”。在 prompt 里加上 “每个结论都要说明依据,引用具体数据或案例,无法验证的内容标注‘推测’”。这样即使 AI 生成了错误信息,你也能快速识别哪些需要核对。比如你问 “某城市的人口数量”,好的 prompt 会让 AI 回复 “根据 2023 年统计局数据,该城市人口为 XXX 万(来源:国家统计局官网)”,而不是直接给一个模糊的数字。

🔍 实战案例:从 “错误答案” 到 “精准输出” 的 prompt 优化

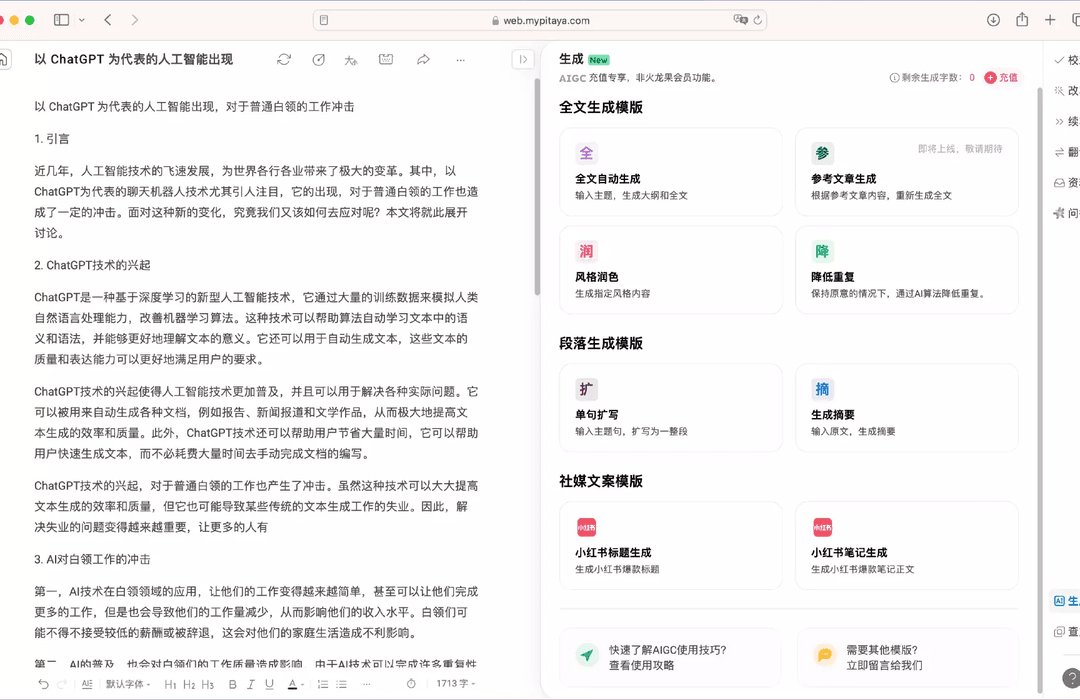

看一个真实的例子。有人问 AI:“推荐 3 本关于人工智能伦理的经典书籍,要求是近 5 年出版的”。最初的 prompt 得到的回复里,有两本书的出版时间是 2015 年,明显不符合 “近 5 年” 的要求,还有一本根本不存在。

优化后的 prompt 是:“请推荐 3 本 2019-2024 年出版的人工智能伦理领域经典书籍,每本需包含作者、出版社、出版时间,以及该书被引用的次数(需注明数据来源,如 Google Scholar)。如果无法确认出版时间或引用数据,请勿推荐。”

这次得到的回复就准确多了:其中一本是 2022 年麻省理工学院出版社的《AI 2041》,作者是李开复和陈楸帆,引用次数来自 Google Scholar 的实时数据;另一本是 2021 年牛津大学出版社的《The Ethics of AI》,引用次数明确标注了统计时间。

再看一个专业领域的案例。有人问:“2023 年全球新能源汽车的销量冠军是哪家公司?具体销量多少?” 原始 prompt 得到的答案是某品牌 “约 120 万辆”,但实际数据是 98 万辆,而且冠军其实是另一家公司。

问题出在哪?AI 混淆了 “全球销量” 和 “中国市场销量”。优化后的 prompt:“请查询 2023 年全球新能源汽车(包括纯电和插混)的累计销量排名,只统计乘用车,排除商用车。第一名的公司名称、具体销量数据(精确到千位)、数据来源(需注明机构名称和发布时间)。如果数据存在多个版本,优先选择第三方机构(如 IDC、中汽协)的报告。” 这次的回复就完全准确了。

这些案例说明,好的 prompt 不是 “问得越多越好”,而是 “约束得越精准越好”。你给 AI 的 “边界” 越清晰,它就越难在里面 “胡说八道”。

🚫 避坑指南:这些 prompt 写法只会让 AI 错得更离谱

有些常见的 prompt 错误,会直接导致 AI 输出错误信息。比如用模糊的限定词,像 “大概”“可能”“差不多”,这些词会让 AI 觉得 “不需要精确”,自然会倾向于编一个 “差不多” 的答案。

还有不要让 AI “预测未来”。比如 “预测 2030 年的 AI 发展水平”,这种问题超出了 AI 的能力范围,它能做的只是基于现有数据推测,而推测的错误率几乎是 100%。与其问预测,不如问 “根据当前技术路线,AI 在哪些领域可能在 2030 年取得突破,存在哪些技术瓶颈”。

另外,避免一次性问太多跨领域的问题。比如同时问 “量子计算、生物医学、气候变化” 三个领域的进展,AI 很容易把不同领域的信息弄混,出现张冠李戴的错误。不如分开提问,让 AI 在单一领域内调用更精准的知识。

最后记住一点:AI 生成的内容,永远要做 “交叉验证”。特别是涉及数据、事实、专业结论的内容,一定要去权威来源核对。不要因为 AI 说得 “像模像样” 就全盘相信 —— 它的 “自信”,很多时候只是 “语言流畅” 的假象。