🔒 硬件级防护:大模型一体机的安全护城河

2025 年,大模型技术在各行业的渗透速度越来越快,但安全风险也像影子一样紧紧跟随。数据显示,近九成企业部署的大模型服务器存在 “裸奔” 隐患,数据泄露、模型篡改、算力劫持等问题频发。这时候,大模型一体机就像一位身披铠甲的骑士,为企业打造了一道坚实的安全防线。

大模型一体机的核心优势,在于它实现了从硬件到软件的完全自主可控。传统 AI 服务器大多依赖国外芯片,存在供应链断供风险和后门漏洞隐患。而国产大模型一体机通过 “国产 CPU + 国产加速卡 + 自主操作系统” 的深度适配,彻底摆脱了对外部技术的依赖。比如埃文科技推出的基于华为昇腾算力的企业一体机,不仅提供本地昇腾算力和 DeepSeek 大模型,还整合了 RAG 知识库,为企业提供一体化解决方案。这种硬件级的防护,就像是给服务器穿上了一层防弹衣,从源头隔绝了潜在的安全威胁。

在数据隐私方面,大模型一体机更是表现出色。传统云端大模型需要将企业数据上传至第三方服务器,这就像是把自家的钥匙交给了陌生人,极易遭遇中间人攻击或数据滥用。而大模型一体机通过本地化私有部署,实现数据 “不出库、不离域”,从物理层面切断了外部渗透的可能。想象一下,你的数据就像被锁在自家的保险箱里,只有你自己有钥匙,这种安全感是云端服务无法比拟的。

🛡️ 2025 年 AI 安全的三大核心挑战

随着 AI 技术的不断发展,安全挑战也在不断升级。2025 年,企业面临的 AI 安全问题主要集中在三个方面:AI 治理控制、运行时安全和渗透测试。

AI 治理控制是确保 AI 系统合规运行的关键。企业需要建立完善的 AI 治理框架,明确 AI 的使用范围、权限和责任。例如,通过 AI 发现与清单管理解决方案,追踪企业内 AI 的位置、用途及责任人,避免出现 “影子 AI” 带来的风险。同时,还需要对 AI 生成的内容进行严格审查,防止出现违法或敏感信息。

运行时安全是当前企业 AI 安全中改进空间最大的领域。攻击者可能通过各种手段对正在运行的 AI 模型进行攻击,如 Prompt 注入、模型篡改等。这就需要企业部署实时监控系统,及时发现并应对异常行为。例如,深信服的安全 GPT 通过数据融合、误报过滤等方式,将海量告警消减率高达 99.75%,并能在 15 分钟内遏制重大事件,大大提升了运行时的安全性。

渗透测试则是主动发现系统漏洞的重要手段。通过模拟黑客攻击,企业可以提前发现系统的薄弱环节,并进行修复。例如,使用 AI 驱动的渗透测试工具,如 WhiteRabbitNeo 和 PenTestGPT,能够快速识别系统漏洞,帮助企业提升防御能力。

🕵️ 攻防实战:AI 驱动的新型攻击与防御策略

2025 年,黑客利用 AI 辅助攻击的技术手段越来越多样化和隐蔽化。自动化漏洞挖掘、模型篡改、社会工程等攻击方式层出不穷,给企业带来了巨大的挑战。

自动化漏洞挖掘是黑客常用的手段之一。通过训练 AI 模型扫描代码库,黑客可以快速识别缓冲区溢出、逻辑漏洞等高危风险点,并自动生成针对特定漏洞的利用代码。例如,在 2025 年披露的 “规则文件后门” 攻击中,黑客通过隐藏的 Unicode 字符和双向文本标记操控 AI 代码编辑器,使其生成包含后门的代码片段,这些代码看似合规,实则暗藏恶意功能。

模型篡改也是一种常见的攻击方式。攻击者通过逆向获取模型文件,修改最后一层神经元的权重参数,使系统错误授权非法用户。例如,在虹膜识别模型中,将负样本权重调整为正向响应阈值,即可绕过身份验证。为了应对这种攻击,企业需要建立模型完整性校验机制,定期检查模型参数是否被篡改。

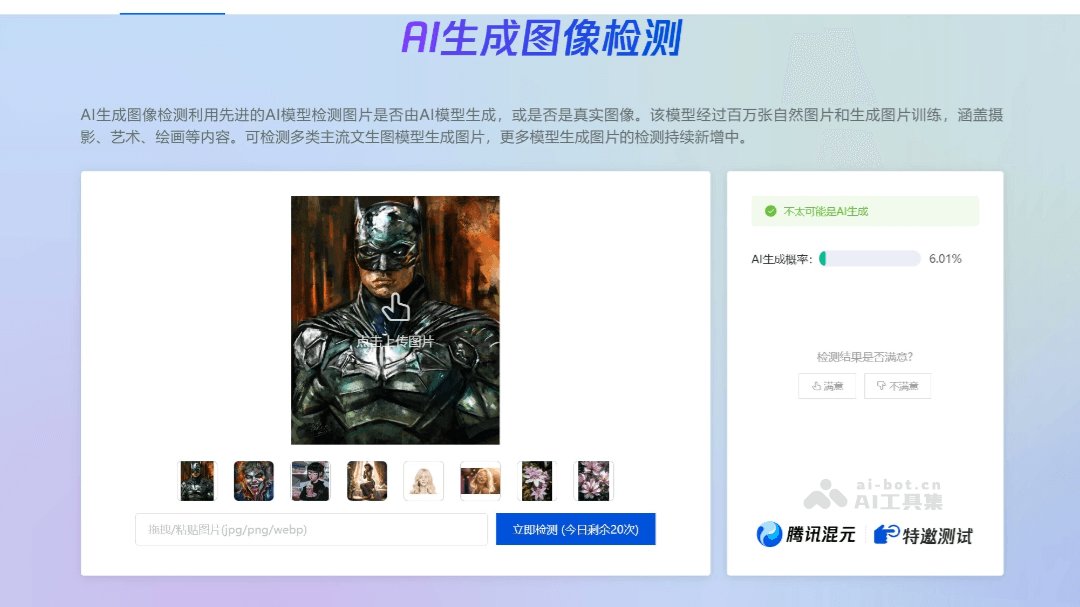

社会工程攻击则利用 AI 生成高度个性化的钓鱼内容,模仿企业高管的语言风格和近期事件,诱导员工点击恶意链接或泄露凭证。这种攻击的成功率较传统模板提升了 3 倍以上。企业需要加强员工培训,提高识别钓鱼攻击的能力,同时部署 AI 驱动的钓鱼检测系统,实时拦截恶意内容。

🌐 政策与合规:构建 AI 安全的法律框架

政策法规是保障 AI 安全的重要支撑。2025 年,各国纷纷出台相关政策,加强对 AI 的监管。例如,上海通过《上海市促进人工智能产业发展条例》,设立 AI 伦理委员会,建立定期审查机制,要求企业对 AI 模型进行备案和登记。同时,还出台了配套政策,推动 AI 大模型的创新发展与安全治理。

企业需要积极响应政策要求,建立符合法规的 AI 安全体系。例如,商汤科技发布的 SenseTrust 治理平台,提供从数据治理到应用治理的全链路解决方案,对有毒数据的检测率超过 95%,对抗样本的综合检出率达到 98%。百度构建的可信 AI 技术体系,也参与了全球规则对话,为 AI 安全标准的制定做出了贡献。

此外,政策还推动了 AI 安全技术的发展。例如,国家数据基础设施建设指引要求构建全流程动态安全保障体系,推动安全防护由静态保护向动态保护转变。这促使企业加大在 AI 安全技术上的投入,如奇安信基于 QAX-GPT 安全大模型发布的 AISOC,通过 AI 数字员工实现 7*24 全天候监控,大大提升了安全运营效率。

🚀 中小企业的突围之道:AI + 云端专家的协同防御

对于中小企业来说,面对复杂的 AI 安全挑战,往往面临着技术、资金和人才的多重压力。深信服的安全托管方案为中小企业提供了一条突围之路。

深信服的安全托管方案依靠云端安全 GPT 大模型和云端安全专家的协同,实现了安全事件的高效研判和处置。以 60 万条安全日志为例,传统安全运营需要多人多天才能完成分析,而深信服的方案仅需 39.5 分钟即可生成 8 条真实攻击事件,准确率高达 99%。这种高效的协同防御,就像是为中小企业配备了一支专业的安全团队,无需自己投入大量资源。

安全 GPT 的核心能力在于其对攻击代码的理解能力。它就像一个懂攻防、懂代码、懂协议的安全专家,能够发现传统检测引擎无法识别的高对抗、高绕过攻击。同时,云端安全专家结合自身多年的实战经验,对大模型未能定性的事件进行进一步分析,确保不放过任何一个潜在威胁。

这种 “AI + 云端专家” 的模式,不仅提升了安全防护的效率,还降低了中小企业的成本。无需部署和训练大模型,也无需聘请专业的安全团队,中小企业只需支付一定的服务费用,即可享受最先进的安全防护能力。例如,深信服的安全托管方案能够在 15 分钟内遏制重大事件,并实现 100% 闭环处置,为中小企业的业务安全提供了坚实保障。

在 AI 技术飞速发展的今天,安全已经成为企业部署 AI 工具时不可忽视的重要环节。无论是硬件级的防护,还是政策法规的支持,亦或是中小企业的创新解决方案,都在为构建安全可靠的 AI 生态贡献力量。未来,随着机密计算、联邦学习等技术的融合,AI 安全的边界将进一步拓展,为数字中国建设提供更坚实的保障。

该文章由

diwuai.com第五 ai 创作,第五 AI - 高质量公众号、头条号等自媒体文章创作平台 | 降 AI 味 + AI 检测 + 全网热搜爆文库

🔗立即免费注册 开始体验工具箱 - 朱雀 AI 味降低到 0%- 降 AI 去 AI 味