🔒朱雀 AI 检测值对抗攻击漏洞防护:模型安全检测方案

在人工智能技术高速发展的当下,AI 模型的安全问题日益凸显。对抗攻击作为一种针对 AI 模型的恶意手段,通过在输入数据中注入微小扰动,使模型做出错误决策,严重威胁着 AI 系统的可靠性和安全性。腾讯朱雀实验室推出的 “朱雀” AI 大模型检测系统,正是为应对这一挑战而设计的解决方案。

🔍对抗攻击的威胁解析

对抗攻击的核心在于利用模型学习到的特征和决策边界中的 “盲点”。攻击者通过向输入数据添加人类难以察觉的微小扰动,使得模型在保持输入语义不变的情况下做出错误判断。比如在图像分类任务中,原本被正确分类为 “猫” 的图片,经过对抗攻击添加微小扰动后,模型可能会将其误分类为 “狗”。这种攻击不仅影响模型的准确性,还可能导致严重的安全事故,如自动驾驶中错误识别道路标识引发车辆事故。

在企业私有部署场景下,对抗攻击的风险更为突出。私有部署的模型通常暴露在内部不可信输入、调试工具接口暴露、缓存可控等复杂攻击路径中,面临输入通路不受控、模型响应可探测、访问通道未加固等问题。据开源安全社区发布的白皮书显示,近一年内 78% 的模型对抗攻击事件发生在企业自建推理系统中,主要分布于金融风控、政务问答等高价值领域。

🛡️朱雀 AI 检测系统的防护机制

朱雀 AI 检测系统通过多维度的技术手段,构建了全方位的对抗攻击防护体系。

输入输出检测

朱雀系统能够对输入(Prompt)和响应(Response)进行分类,判断其是否安全。在输入侧,系统引入 N-gram、字符级扰动检测规则,判断拼写攻击、换词攻击等异常模式,并利用频域分析识别高频扰动异常区域。在输出侧,系统对模型生成内容进行实时检测,确保无违规风险。例如,对于 AI 生成的文本,系统通过分析语法结构、用词模式等特征,结合海量数据学习,判断其是否为 AI 生成,准确率超 95%。

提示词过滤

针对提示注入(Prompt Injection)和越狱攻击(Jailbreak),朱雀系统采用基于分类器的模型进行检测。该模型能够识别出试图绕过模型安全机制的恶意输入,将输入的提示词划分成良性、注入和越狱三类。例如,在医疗问答场景中,若用户输入包含诱导模型生成错误诊断结果的提示词,系统会及时拦截并给出安全提示。

对抗训练

对抗训练是提升模型鲁棒性的关键手段。朱雀系统通过在训练过程中不断给模型 “看” 精心构造的对抗样本,并告诉模型这些样本的 “正确” 标签,迫使模型学习区分细微的、带有欺骗性的扰动。这种训练方式使得模型的决策边界变得更加平滑和鲁棒,不容易被微小的扰动所干扰。例如,在金融风控系统中,通过对抗训练的模型能够有效识别恶意输入,降低误判率。

🚀实际应用中的表现与案例

在南方都市报的测评中,朱雀 AI 检测系统在文本检测中表现出色。对于老舍经典文学作品《林海》,朱雀达到了准确检测,AI 检测率为 0;对于 AI 生成的散文《林海》,朱雀准确识别出了 AI 生成内容,判定率 100%。在图片检测方面,朱雀对 AI 生成的图片也能准确鉴别,但对经二次编辑的图片存在误判情况,暴露出局部修改图片识别仍有难度。

此外,朱雀实验室还积极参与开源社区的漏洞修复工作。例如,朱雀实验室发现 vLLM 推理框架存在严重安全漏洞(CVE-2025-47277,CVSS 9.8 分),攻击者可利用此漏洞控制 GPU 服务器,窃取模型、算力或中断服务。朱雀实验室迅速向 vLLM 开发团队提供了详细的技术分析和复现步骤,助力团队快速定位问题,目前该漏洞已修复。

📊与其他安全方案的对比

与 Meta 的 PurpleLlama 安全方案相比,朱雀系统在输入输出检测和提示词过滤方面具有相似的技术架构,但朱雀更注重与实际业务场景的结合。例如,在金融风控领域,朱雀系统能够根据业务需求定制检测规则,提高检测的针对性和准确性。与启明星辰的 “AI 大模型从风险识别到安全加固解决方案” 相比,朱雀系统更侧重于模型本身的安全检测,而启明星辰的方案则涵盖了资产全量测绘、供应链安全检测等多个层面。

📝对抗攻击防护的实施步骤

- 数据采集与分析:收集历史样本与真实攻击数据集,使用对比学习与聚类分析,识别分布异常点与稀疏特征组合,建立输入异常规则库。

- 输入增强与压制:对检测到的疑似扰动输入,采用随机遮盖、扰动重构与剪枝抑制等策略进行处理。例如,对高风险 token 进行打码处理,使用教师模型或语义补全模型重构内容。

- 对抗训练:采用两阶段训练机制,第一阶段以原始样本训练,第二阶段加入对抗样本混合训练。同时,融合原始预测损失和对抗样本损失,动态调整对抗样本比例。

- 安全评估与系统联动:与 API 网关、WAF、防火墙等安全设备协同架构,定期进行鲁棒性测试、攻防对抗演练,确保模型服务的安全性和稳定性。

🌟总结与展望

朱雀 AI 检测系统通过多维度的技术手段,为 AI 模型提供了全方位的对抗攻击防护。其在实际应用中的表现证明了该方案的有效性和可靠性。然而,随着对抗攻击技术的不断发展,AI 模型的安全防护也需要持续优化和升级。未来,朱雀实验室将继续深入探索 AI 安全技术,推出更先进的检测和防护方案,为 AI 行业的健康发展保驾护航。

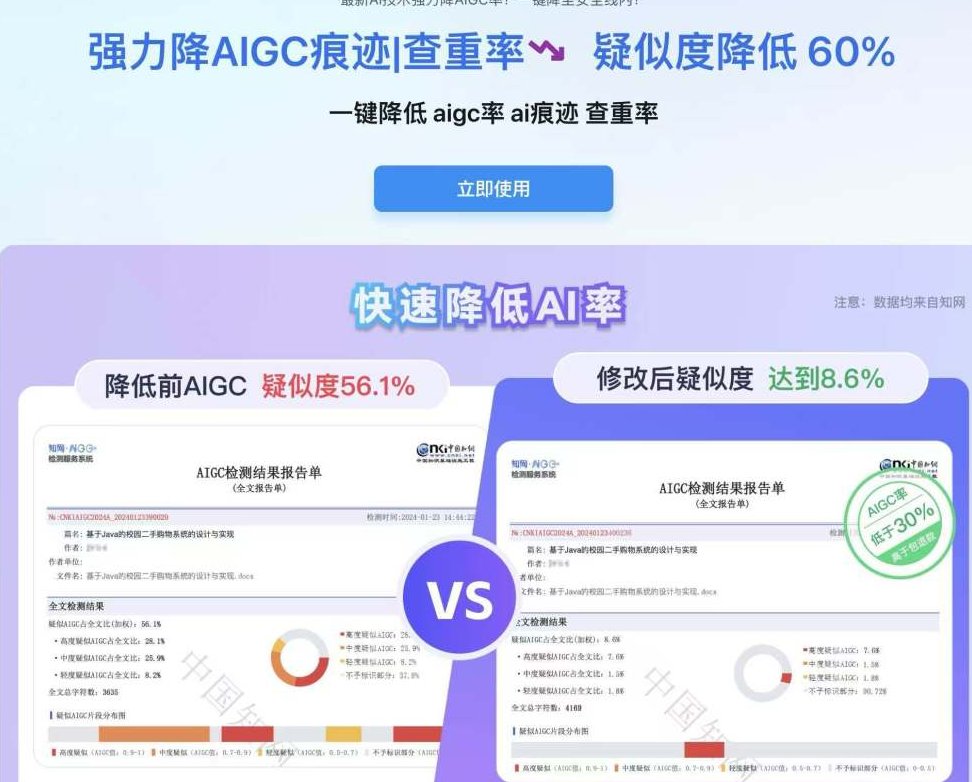

该文章由

diwuai.com 第五 AI 创作,第五 AI - 高质量公众号、头条号等自媒体文章创作平台 | 降 AI 味 + AI 检测 + 全网热搜爆文库

🔗立即免费注册 开始体验工具箱 - 朱雀 AI 味降低到 0% - 降 AI 去 AI 味

(注:文中部分案例和数据来源于公开报道和行业白皮书,具体实施请以实际情况为准。)