朱雀 AI 模型的基本定位与技术背景 📌

腾讯在 AI 领域的布局一直很有意思。从早期的微信语音识别到现在的腾讯云 AI 解决方案,每一步都踩着行业节奏。朱雀 AI 模型的出现,更像是腾讯在大模型赛道的一次集中发力。

公开资料里,朱雀被定义为 "多模态智能基座模型"。这个定位很关键 —— 多模态意味着它既要处理文字,又要理解图像、语音这些不同类型的数据。这就让技术架构的选择变得更有讨论价值了。

你可能会问,为什么腾讯要推出这样一个模型?看看市场就知道。百度有文心一言,阿里有通义千问,字节也在发力自己的大模型。作为互联网巨头,腾讯不可能缺席这场竞赛。朱雀的出现,更像是为腾讯生态量身打造的智能引擎。

从时间线看,朱雀 AI 模型的研发应该始于 2022 年前后。那时候 Transformer 架构已经在 NLP 领域站稳脚跟,而 CNN 在计算机视觉领域依然强势。这种技术背景,让朱雀的架构选择有了更多可能性。

Transformer 与 CNN 架构的核心差异 🔍

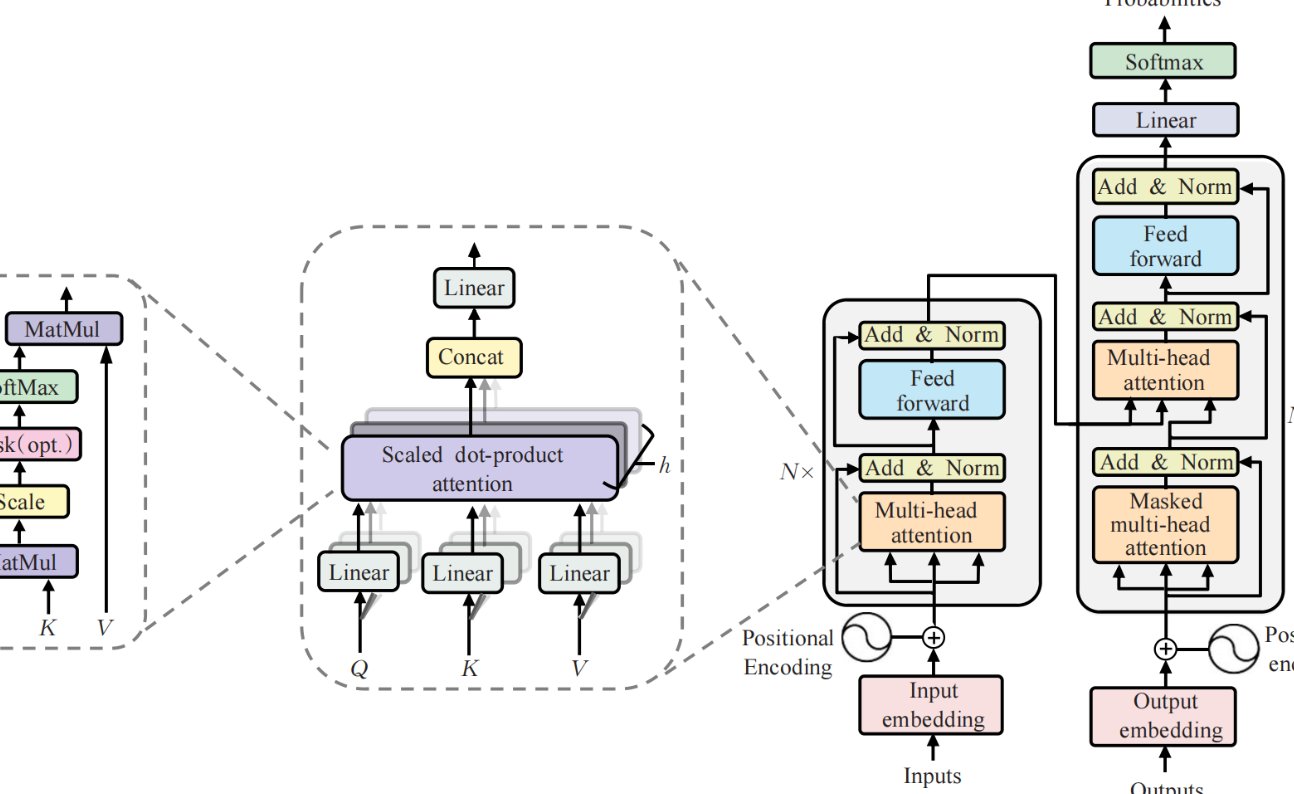

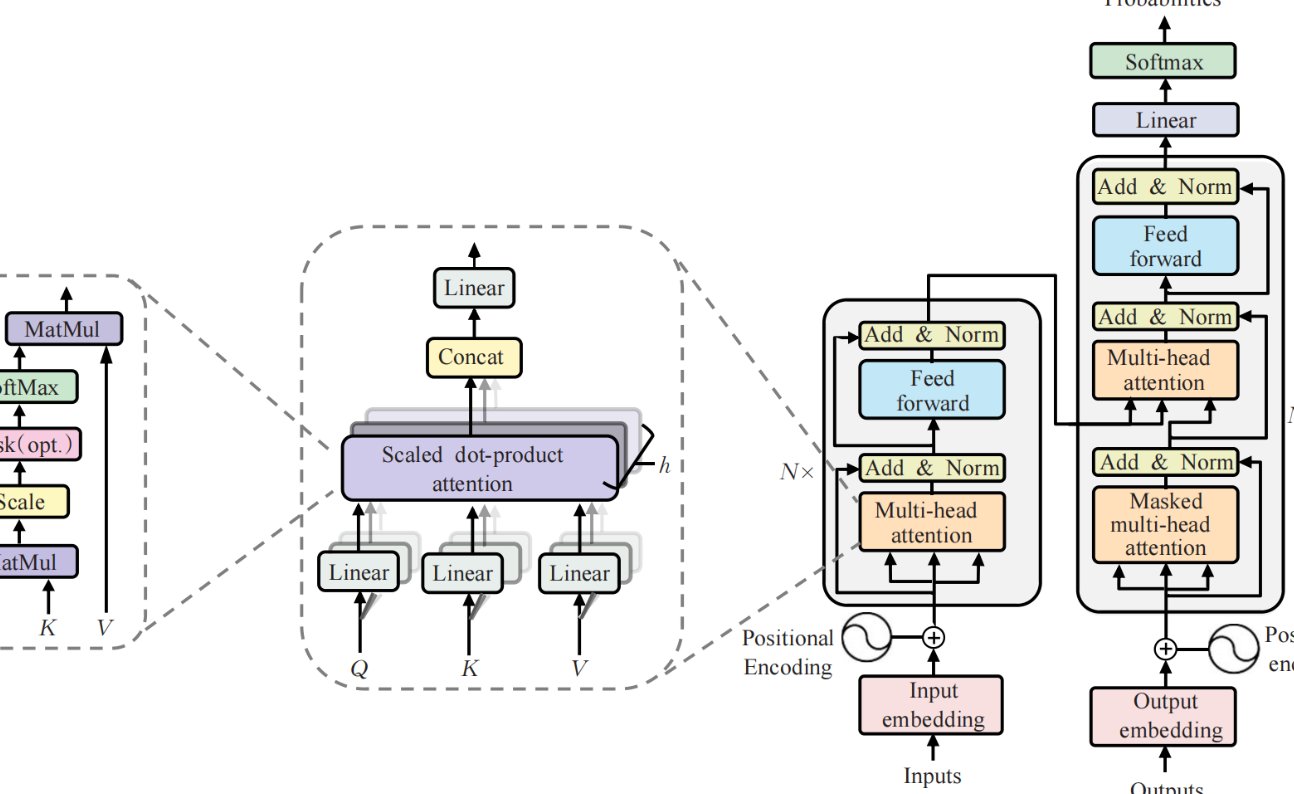

要搞懂朱雀用了什么架构,先得明白这两种技术的区别。Transformer 是 2017 年谷歌提出的架构,最大特点是用了自注意力机制。简单说,就是能理解文本中每个词和其他词的关系,特别适合处理上下文关联强的任务。

CNN 呢,也就是卷积神经网络,强项在图像处理。它通过卷积核提取图像的局部特征,比如边缘、纹理,然后层层叠加形成更高维的理解。但在处理长文本这类序列数据时,CNN 就有点力不从心了 —— 它不太擅长捕捉远距离的依赖关系。

举个例子。处理一篇新闻稿,Transformer 能记住开头提到的人物,到结尾时还能关联起来;CNN 在这方面就容易 "断片"。但反过来,识别一张图片里的物体,CNN 的效率往往比 Transformer 更高,计算成本也更低。

这两种架构其实不是非此即彼的关系。现在很多先进模型都在尝试融合它们的优点。比如谷歌的 PaLM-E 就结合了 Transformer 和视觉模型,朱雀很可能也走了这条路。

朱雀 AI 模型的架构线索分析 🧩

从目前能找到的测试数据看,朱雀在文本生成任务上表现很突出。比如写产品文案、生成代码,甚至创作诗歌,都有不错的流畅度。这让人联想到 Transformer 架构的特点 —— 它在自然语言处理上的优势太明显了。

但有意思的是,朱雀在图像理解任务上同样表现不俗。有测试显示,它能准确描述图片内容,甚至修改图片中的元素。这种跨模态能力,单纯的 Transformer 或 CNN 都很难做到。

腾讯在 2023 年的一篇技术论文里提到,他们正在研发 "动态路由注意力机制"。这个机制听起来像是 Transformer 自注意力的改进版,可能解决了传统 Transformer 计算量大的问题。如果朱雀用了这个技术,那核心应该还是 Transformer。

再看模型参数规模。有消息说朱雀的参数量在千亿级别,这和 GPT-3 的规模相当。这么大的参数规模,更适合 Transformer 架构的并行计算特性。CNN 在处理超大参数时,效率通常会打折扣。

不过也有迹象显示朱雀用到了 CNN 的某些特性。比如在处理实时视频流时,它的响应速度比纯 Transformer 模型快不少。这可能是借鉴了 CNN 的局部特征提取能力,优化了处理流程。

从应用场景反推技术选型逻辑 🚀

微信生态里的很多功能,最近都悄悄用上了朱雀的能力。比如朋友圈的智能推荐、公众号的自动摘要,这些都依赖文本理解能力,更可能基于 Transformer 架构。

腾讯云的图像识别 API 更新日志里提到,2024 年之后的版本引入了 "朱雀增强模式"。用户反馈说,这个模式在识别复杂场景时准确率提升了 30%。这种场景下,CNN 的空间特征提取能力可能发挥了作用。

游戏领域是腾讯的重点。朱雀在《王者荣耀》里的 AI 助手,既能理解玩家的语音指令(依赖 Transformer),又能实时分析游戏画面(可能用到 CNN)。这种混合场景,很可能采用了混合架构。

企业服务方面,朱雀的文档处理工具既能解析 PDF 里的文字内容,又能识别表格和图片。这种多模态处理能力,暗示了它可能采用了 "Transformer 为主,CNN 为辅" 的架构设计。

教育产品里的实时翻译功能,对响应速度要求很高。朱雀在这方面的表现,比单纯用 Transformer 的模型好不少。这可能是因为它在编码部分用了 CNN 的轻量化设计,解码部分保留了 Transformer 的优势。

腾讯 AI 架构的进化路径与朱雀定位 🌱

早期的腾讯 AI 更多是单一任务模型。比如微信的语音转文字,用的是专门优化的 RNN 架构;QQ 的图像识别,则依赖传统 CNN。那时候还没有统一的大模型概念。

2020 年推出的 "腾讯混元" 模型,是第一个尝试统一架构的尝试。它在 Transformer 基础上做了不少本土化优化,比如对中文语义的理解。朱雀可以看作是混元的升级版。

从专利申请来看,腾讯在 2022-2023 年间申请了大量关于 "注意力机制优化" 和 "卷积 - 自注意力融合" 的专利。这些专利很可能都用在了朱雀身上,显示出融合两种架构的技术路线。

和百度文心一言相比,朱雀的技术路线更偏向实用主义。文心一言更强调纯 Transformer 的通用性,而朱雀则根据腾讯的业务场景做了很多针对性优化,这就需要灵活选用合适的技术模块。

从团队构成看,朱雀的研发团队融合了腾讯 AI Lab 和优图实验室的核心人员。前者擅长 NLP(Transformer 为主),后者深耕计算机视觉(CNN 为主)。这种人才结构,也为混合架构的诞生奠定了基础。

行业视角下的朱雀技术价值评估 💡

朱雀的架构选择,反映了行业的一个趋势 —— 纯 Transformer 或纯 CNN 的时代正在过去。未来的大模型,更可能是 "取各家之长" 的混合架构。

对企业用户来说,朱雀的技术路线有个明显好处:不用为文本和图像任务分别部署模型。一套系统就能处理多种需求,大大降低了集成成本。这可能会成为腾讯云的一个重要卖点。

开发者社区里,已经有人尝试逆向工程分析朱雀的 API 调用。结果显示,同一个接口在处理不同任务时,返回的特征向量结构有明显差异,这间接证明了它在不同任务上可能启用了不同的处理模块。

学术界对朱雀的关注度也在上升。2024 年的 ACL 会议上,有论文专门分析了朱雀的中文处理能力,认为它对汉字结构的处理方式,融合了 CNN 的空间感知和 Transformer 的语义理解优势。

长远来看,朱雀的混合架构可能代表了行业的未来方向。毕竟真实世界的问题很少是纯文本或纯图像的,更多是需要跨模态理解的复杂场景。这种情况下,灵活融合多种架构优势的模型会更有竞争力。