最近几年,AI 写作工具像雨后春笋一样冒了出来。从最初简单的语法纠错,到现在能生成完整的论文框架,甚至模拟不同学科的写作风格。这股热潮也吹进了学术圈,不少研究生、学者开始用 AI 来辅助研究。但问题来了,AI 写作真的能取代人类搞学术研究吗?更让人揪心的是,它给科研诚信带来的挑战,我们真的准备好了吗?

📊 AI 写作闯进学术圈:到底能干点啥?

现在的 AI 写作工具,确实有两把刷子。就拿文献综述来说,以前得花好几个星期泡在数据库里,一篇篇筛选、整理。现在用 AI,把关键词输进去,几分钟就能生成一份初步的综述,还会标出核心观点和争议点。这对刚开始做研究的学生来说,简直是救星。

还有数据处理后的分析部分,AI 也能帮上忙。比如把实验数据导入工具,它能自动生成描述性文字,甚至提出几种可能的解释方向。有位生物系的朋友就跟我说,用 AI 写实验报告的结果部分,效率提高了快一半。

不过你要是仔细看这些 AI 生成的内容,会发现它有个大问题 —— 缺乏深度。比如讨论研究局限性的时候,AI 总是说些 “样本量不够大”“研究范围有限” 之类的套话,没法像人那样结合具体研究场景,挖出真正关键的缺陷。这就像考试时的标准答案,看似没错,却没什么思考痕迹。

🚫 说 AI 能取代人类做学术研究?简直是天方夜谭!

学术研究的核心是什么?是创新,是提出新问题、找到新方法、得出新结论。这活儿,AI 干不了。为啥?因为 AI 的本质是对已有信息的重组和模仿,它没有真正的 “思考” 能力,也不会产生 “好奇心”。

就拿理论突破来说,历史上重大的学术发现,往往源于研究者跳出传统框架的灵光一闪。爱因斯坦提出相对论,不是靠整理已有的物理知识,而是颠覆了人们对时间和空间的固有认知。这种颠覆性的创新,AI 根本搞不出来。它能在现有理论框架内做推演,但没法自己搭建新框架。

还有学术争论中的思辨过程,AI 也插不上手。比如两个学者对同一现象有不同解释,他们会互相反驳、补充,在辩论中让观点越来越清晰。AI 生成的内容总是四平八稳,缺乏这种针锋相对的锐气,更不会像人那样在争论中完善自己的想法。

再说了,学术研究不只是写论文,还包括设计实验、解读复杂数据、考虑研究的伦理影响等。这些环节都需要人类的判断力和责任感。比如医学研究中,一个实验设计可能关系到受试者的安危,AI 可不会考虑这些,它只会按算法给出 “最优解”,而这个 “最优解” 可能违背伦理准则。

⚠️ 科研诚信的 “隐形杀手”:AI 写作藏着不少坑

最让人头疼的是 AI 写作给科研诚信带来的麻烦。现在已经出现了学生用 AI 写论文,不注明来源,直接当成自己的成果提交的情况。更严重的是,有些 AI 工具会 “编造” 参考文献 —— 你看着它列出的文献格式规范,作者、期刊、年份都有,但去数据库里一查,根本不存在这篇文章。

还有数据造假的问题。有团队发现,用 AI 处理不太理想的实验数据时,它会 “不自觉” 地美化结果,比如把波动较大的数据调整得更符合预期趋势。如果研究者不仔细核对,直接用这些内容,就会造成学术不端。

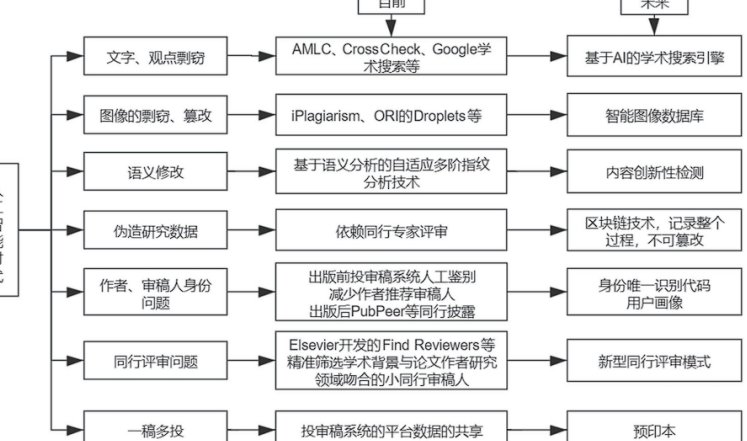

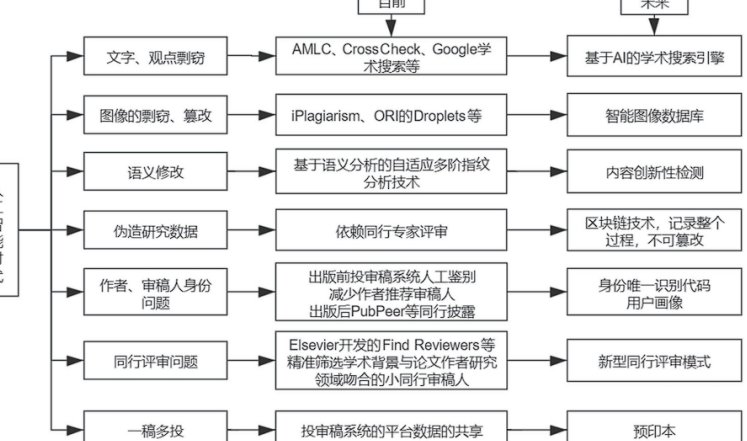

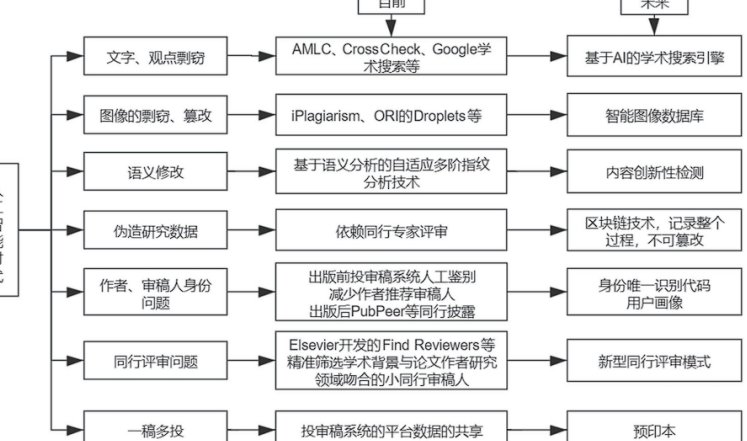

学术期刊编辑部现在也焦头烂额。以前查重主要看是否抄袭已发表的文章,现在得辨别哪些内容是 AI 生成的。虽然有了一些 AI 检测工具,但准确率并不高。有位编辑朋友吐槽,上个月退了一篇论文,因为检测显示 AI 生成比例超过 40%,结果作者申诉说那是自己写的,只是用词比较 “规范”,最后查了半天也没搞清楚到底咋回事。

更隐蔽的问题是 “思想懒惰”。过度依赖 AI 的话,研究者可能会逐渐失去独立思考的能力。比如遇到研究瓶颈时,不是自己苦思冥想,而是直接让 AI 给方案,久而久之,研究能力只会越来越差。

🛡️ 守住科研诚信的底线:我们能做些什么?

面对 AI 带来的挑战,学术圈已经开始行动了。不少高校更新了学术规范,明确要求学生在论文中注明哪些部分用了 AI 写作,以及用的是哪种工具。就像引用文献一样,AI 辅助的内容也得有 “来源标注”。

期刊方面,一些顶级杂志已经推出了 AI 使用声明制度。作者投稿时必须说明是否使用了 AI 工具,以及使用的范围和程度。审稿人也会针对性地检查 AI 可能 “偷懒” 或 “出错” 的部分,比如数据解读和理论创新点。

对研究者自身来说,提高媒介素养太重要了。得学会辨别 AI 生成内容的优劣,知道哪些地方可以用 AI 辅助,哪些地方必须自己动手。比如用 AI 整理文献时,要逐一核对原文;用 AI 生成的观点,要反复追问 “为什么”,直到形成自己的理解。

还有一点不能忽视 —— 教育。从研究生阶段就应该开设相关课程,不光教怎么用 AI 工具,更要讲清楚 AI 写作的边界和风险。让学生明白,学术研究的价值不在于写出完美的文字,而在于整个探索过程中的思考和付出。

🎯 未来的学术研究:人类和 AI 该怎么相处?

说到底,AI 写作工具就是个高级助手。用得好,能帮我们节省时间、提高效率;用不好,就会变成学术不端的帮凶。关键在于找到人和 AI 的平衡点。

比如,前期文献搜集和整理,让 AI 来做;但形成研究问题和假设,必须自己来。数据分析时,AI 可以提供初步解读;但深入讨论和引申,还得靠人。就像木匠用刨子,工具再好,做出什么样的家具,还是看木匠的手艺和想法。

科研诚信的维护,也不能只靠制度约束,更得靠研究者的自觉。毕竟学术研究的意义,在于为人类知识宝库添砖加瓦,而不是追求发表论文的数量。当你真正热爱自己的研究领域,就会明白,AI 可以帮你敲钉子,但盖出什么样的房子,最终还是由你决定。

AI 写作给学术研究带来的冲击,说到底是对我们自身的考验。考验我们能不能在便利面前守住底线,能不能在效率之外不忘初心。只要我们始终清楚,学术研究的主角永远是人,AI 不过是个工具,那科研诚信的根基就不会动摇。毕竟,机器可以生成文字,但创造知识、追求真理的,只能是活生生的人。

【该文章由diwuai.com第五 ai 创作,第五 AI - 高质量公众号、头条号等自媒体文章创作平台 | 降 AI 味 + AI 检测 + 全网热搜爆文库🔗立即免费注册 开始体验工具箱 - 朱雀 AI 味降低到 0%- 降 AI 去 AI 味】