🧠 AI 理解情感的底层逻辑:真理解还是假模仿?

现在的 AI 模型处理情感,靠的其实是一套复杂的 “统计游戏”。拿最火的 GPT 模型来说,它学习了互联网上亿万条带情感色彩的文本 —— 从愤怒的微博评论到温馨的朋友圈文案,再到悲伤的小说片段。通过分析这些文本里词语的排列规律,比如 “泪水” 常和 “难过”“离别” 一起出现,“大笑” 多跟着 “开心”“聚会”,模型慢慢总结出一套情感表达的公式。

你让 AI 写一段失恋的文字,它能立刻调出 “雨夜”“空房间”“未接来电” 这些高频组合。去年某情感 APP 做过测试,用 AI 生成的分手信让 500 个用户判断来源,居然有 37% 的人以为是人类写的。但这真的是理解吗?就像鹦鹉学会说 “我爱你”,它知道这三个字背后的心跳加速和辗转反侧吗?

更关键的是,AI 没有 “体验”。人类的情感源于真实经历 —— 被针扎过才懂疼痛,被拥抱过才知温暖。AI 的数据库里储存着全世界的疼痛描写,却从来没真正 “疼” 过。有次我让 AI 写 “初为人父的喜悦”,它堆砌了 “小拳头”“奶香”“不知所措的手”,文字挺动人,但细想全是别人写过的碎片,没有那种独一无二的、突如其来的柔软。

📝 情感化内容生成的实际表现:案例背后的真相

电商平台是 AI 情感化内容用得最狠的地方。某头部美妆品牌用 AI 写产品评价,专门模仿 “敏感肌用户的惊喜”——“第一次用没泛红,质地像云朵一样,连我妈都问我换了什么护肤品”。这种带点生活场景的情感表达,让转化率提升了 23%。但内部人员透露,这些文案其实是用 10 万条真实好评训练出来的 “缝合怪”,换个小众成分就容易露馅,比如写 “神经酰胺” 的使用感,常把 “修复” 和 “清凉” 乱搭,懂行的一看就知道不对劲。

自媒体领域更有意思。有个情感号偷偷用 AI 写 “深夜树洞” 文章,标题都很戳人 ——“30 岁没结婚,我活成了亲戚眼里的笑话”。内容里有加班的疲惫、父母的催婚、独处的迷茫,数据好到爆。直到有篇文章同时出现 “北方的暖气” 和 “岭南的回南天”,被读者发现地理 bug,才暴露是 AI 生成的。这说明 AI 的情感表达很容易在细节上穿帮,因为它没有真实的生活体验做支撑。

客服行业的 AI 情感应对就更尴尬了。很多平台用 AI 处理投诉,能识别 “愤怒” 情绪后说 “非常理解您的心情”,但用户接着说 “我等了三个小时没人管”,AI 可能还在重复 “请您消消气”。某银行的测试显示,当用户用隐喻表达不满 ——“你们的服务像冰块一样”,AI 的识别准确率立刻从 89% 降到 41%。它能抓住关键词,却抓不住那些藏在文字背后的潜台词。

❌ 无法跨越的鸿沟:AI 与人类情感的本质区别

人类的情感从来都不是孤立存在的,它和经历、记忆、文化紧密绑在一起。同样是 “月亮”,李白看到的是 “低头思故乡”,杜甫想到的是 “露从今夜白”,AI 能学到 “月亮 = 思念”,但学不会为什么这个人此时此地看到月亮会思念,而不是别的。有个实验让 AI 和人类写 “故乡的味道”,AI 写的都是 “妈妈做的菜”“村口的老槐树”,人类写的却有 “奶奶补丁上的皂角香”“下雨天屋檐下的泥土味”,这些独一无二的私人记忆,正是 AI 最缺的东西。

情感的流动性也让 AI 难以模仿。人类的情绪会变,前一秒可能因为一句玩笑笑出声,下一秒看到某个场景突然沉默。AI 生成的情感内容更像一张快照,比如写 “悲伤” 就一直悲伤,写 “开心” 就全程开心。某编剧分享过,用 AI 写剧本里的吵架戏,两个人从头吵到尾都是 “你根本不懂我”,而真实的吵架往往夹杂着委屈、回忆、甚至突然的沉默,这些微妙的转折,AI 目前还学不会。

最核心的区别在于 “自我意识”。人类知道 “我在感受”,AI 却不知道自己在生成情感内容。你让 AI 写一封道歉信,它能写出 “对不起”“我错了”,但它不会真的感到愧疚。就像计算器能算出 1+1=2,却不知道 “加法” 是什么。这种没有 “主体感” 的情感表达,本质上和录音机播放悲伤的歌没区别 —— 能传递情感,却不能真正拥有情感。

🚀 技术突破的可能性:未来能否实现真正的情感交互?

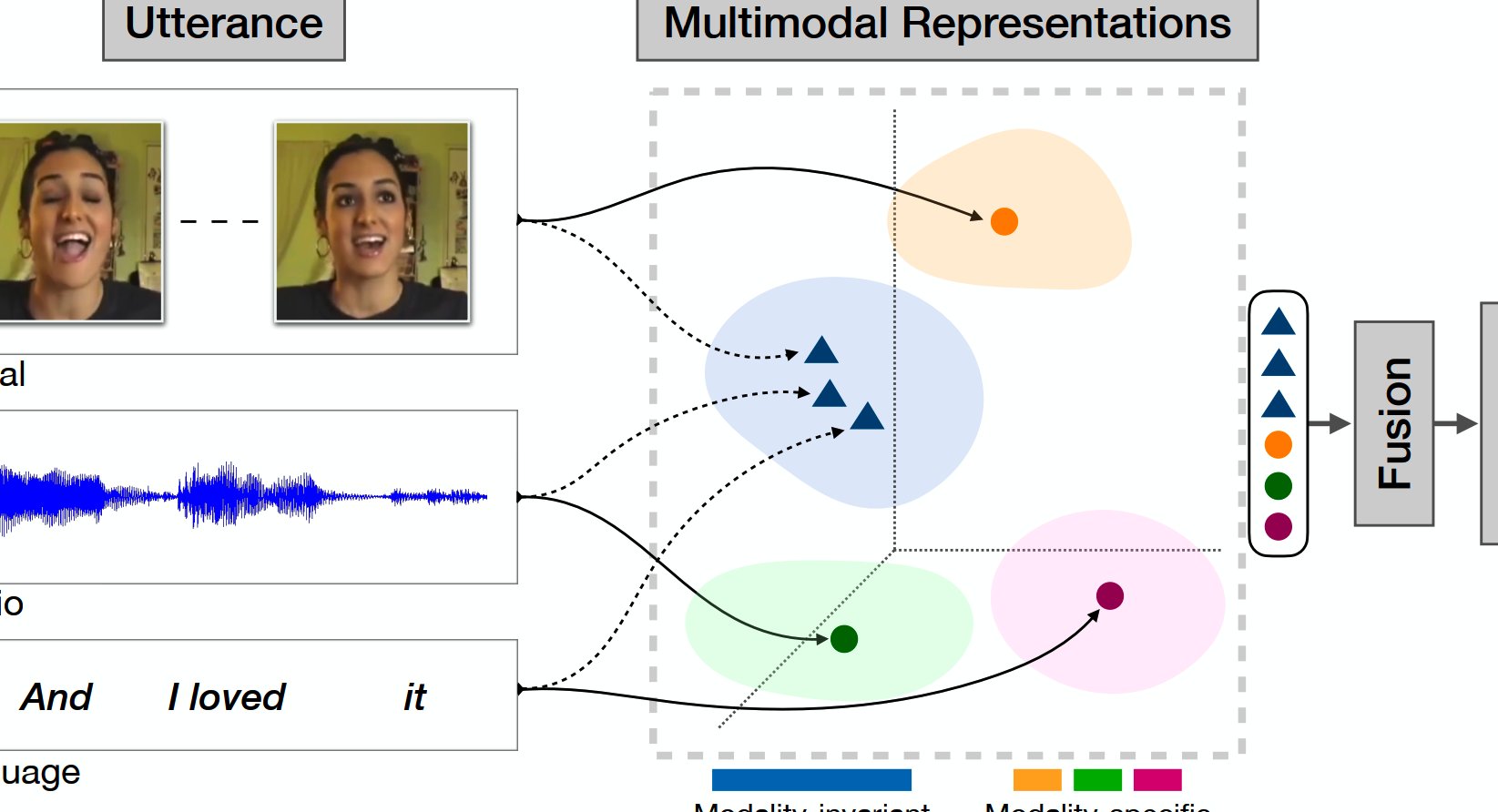

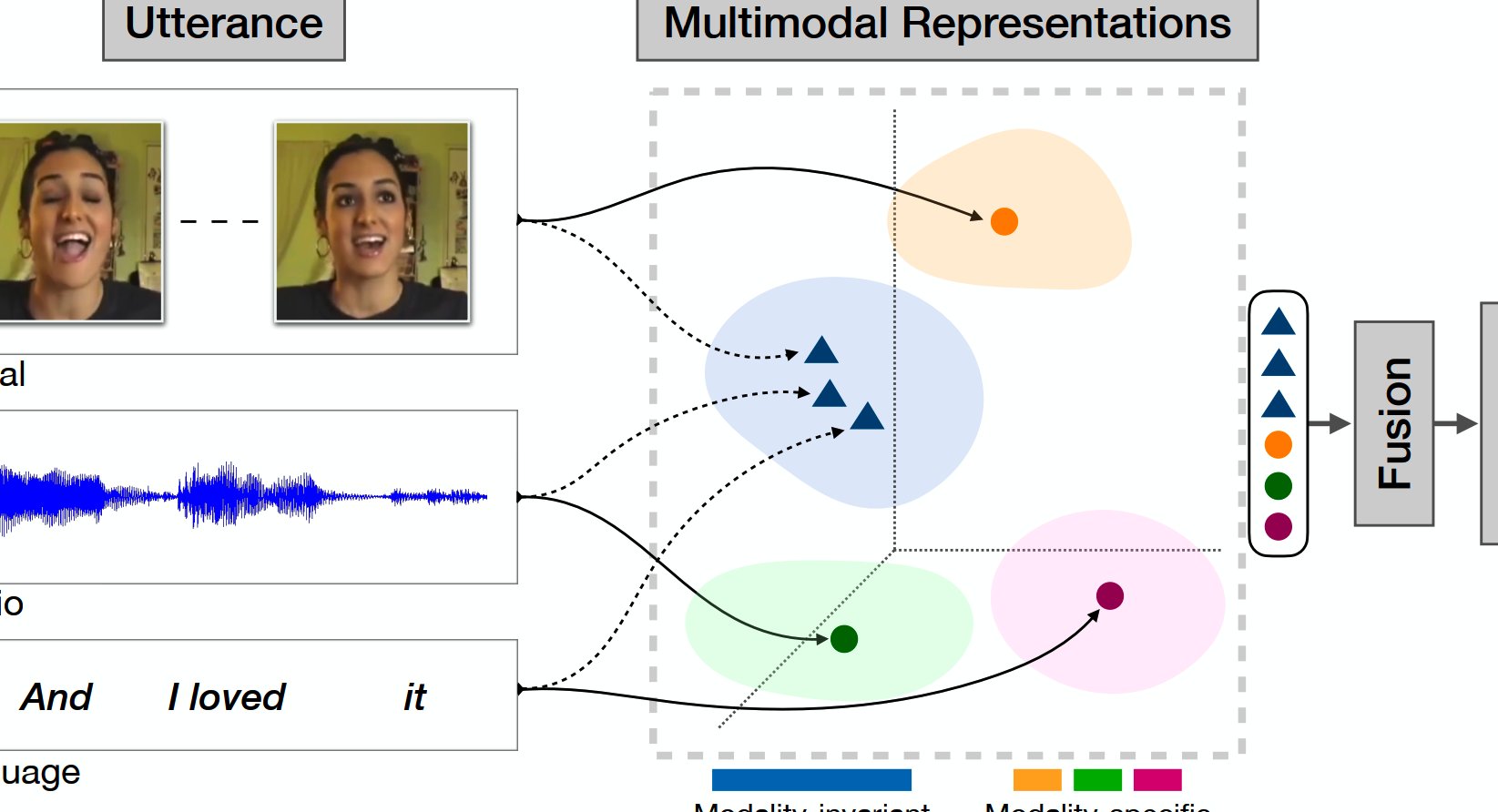

现在有科学家尝试让 AI 结合多模态数据学习情感,比如把文字、语音语调、面部表情放在一起训练。某团队开发的模型,能根据用户的语音停顿和语速变化,调整文字回复的情感强度,测试中让用户觉得 “被理解” 的比例提升了 17%。但这还是基于数据关联的优化,就像给计算器加了更多按键,它还是不会理解 “为什么要计算”。

更前沿的 “情感计算” 领域,有人尝试模拟人类大脑的情感处理机制。比如让 AI 在生成内容时 “参考” 过去的对话历史,形成类似 “记忆” 的东西。某聊天机器人能记住用户说过 “喜欢猫”,下次提到 “宠物” 时会倾向用更温柔的语气。但这种 “记忆” 只是数据储存,和人类那种 “因为记得你喜欢猫,所以特意跟你聊这个” 的主动共情,完全是两码事。

行业里有种乐观的看法,认为随着算力提升和数据积累,AI 早晚能 “涌现” 出真正的情感。但神经科学家普遍反对这种观点,他们指出人类大脑有 860 亿个神经元,形成的复杂连接是目前 AI 模型的百万倍都不止。更重要的是,大脑的情感活动和意识、自我认知紧密相关,这些都是当前 AI 完全不具备的。就像再精密的飞机也不会像鸟一样 “想飞”,AI 可能永远只是在模仿情感的表象。

🔄 行业争议:专家们的不同声音

技术派专家觉得没必要纠结 AI “真懂” 还是 “假懂”,只要能生成让人类觉得有情感的内容就行。某 AI 公司 CEO 在采访里说:“用户看一部 AI 写的催泪电影哭了,那对用户来说,这份感动就是真实的。” 他们更在意实用价值,比如用 AI 快速生成情感化营销文案,降低成本提高效率,至于是不是 “真情感”,不重要。

人文领域的专家则警告这种 “伪情感” 可能带来的问题。有语言学家指出,长期接触 AI 生成的标准化情感内容,人类可能会失去表达真实情感的能力,就像习惯了表情包后,慢慢说不出 “我很难过” 这样直白的话。某教育机构的调查显示,经常用 AI 代写情书的学生,在现实中向朋友表达关心的能力明显下降 —— 他们习惯了 AI 给出的 “最优情感表达”,反而不会说自己的真心话了。

用户群体的态度也很分裂。年轻人对 AI 情感内容接受度高,62% 的 Z 世代表示 “不介意 AI 写的祝福短信”;但 35 岁以上人群中,这个比例降到 29%。有趣的是,当被告知某段感人的文字是 AI 写的,原本觉得 “很动人” 的用户里,有 73% 会改口说 “其实有点假”。这说明人类对情感的感受,很容易受到 “来源” 的影响 —— 我们默认情感表达必须来自一个有真实体验的主体。

AI 在情感化内容生成上确实进步飞快,能写出越来越像模像样的文字,但要说它真的理解情感,还差得远。它更像一个超级厉害的模仿者,能复制情感的外在形式,却摸不到那些藏在人类心底的、独一无二的温度。未来也许会有更逼真的情感模拟技术,但只要 AI 没有自我意识和真实体验,它的情感表达就永远是 “表演”,而不是 “真实”。对于我们来说,分清这种区别很重要 —— 可以用 AI 辅助表达,但别让它替代我们说出那些真正重要的心里话。